Wenn jede Millisekunde zählt

Stell dir vor, du fährst mit deinem Auto durch eine Wohnstraße. Zwischen parkenden Fahrzeugen läuft plötzlich ein Kind auf die Straße. In diesem Moment entscheidet nicht nur dein Reaktionsvermögen – sondern auch die Technik: Das Fahrerassistenzsystem erkennt die Situation und leitet eine Notbremsung ein.

Diese Entscheidung muss in Sekundenbruchteilen fallen. Eine Anfrage an einen Cloud-Server wäre zu langsam – selbst bei minimaler Verzögerung. Noch kritischer: Was passiert ohne Internetverbindung?

In solchen Situationen darf Intelligenz nicht ausgelagert sein. Sie muss direkt im Gerät vorhanden sein. Genau hier setzt eingebettete KI an.

Was ist eingebettete KI?

Eingebettete KI bezeichnet künstliche Intelligenz, die direkt auf einem Gerät ausgeführt wird – also dort, wo die Daten entstehen. Anders als klassische Cloud-KI werden Daten nicht erst an entfernte Server gesendet, sondern lokal verarbeitet.

Dabei geht es meist nicht um große, allgemeine Systeme wie Chatbots, sondern um spezialisierte Lösungen für klar abgegrenzte Aufgaben. Wie das obige Beispiel zeigt, ist diese kleine, eingebette KI bereits in vielen Kontexten im Einsatz und rettet heimlich Leben.

Beispiele aus der Praxis

- Smartphones entsperren: Wenn ein Smartphone das Gesicht seines Nutzers erkennt, geschieht das in der Regel direkt auf dem Gerät. Die Bilddaten verlassen das Gerät nicht, was sowohl Datenschutz als auch Geschwindigkeit verbessert. Gleichzeitig kann sich das System über die Zeit an das Gesicht des Nutzers anpassen und diesen besser erkennen.

- Fahrerassistenzsysteme im Auto: Notbremsassistenten müssen in Echtzeit arbeiten. Sie dürfen weder von einer Internetverbindung abhängen noch Verzögerungen verursachen. Gleichzeitig ist die verfügbare Rechenleistung begrenzt, da das System mit der restlichen Bordelektronik um die Energie der Autobatterie konkurriert.

- Industrie: Sensoren an Maschinen erkennen frühzeitig Abweichungen und mögliche Defekte. Da solche Systeme oft in abgeschlossenen Industrieumgebungen eingesetzt werden, ist eine Cloud-Anbindung nicht immer möglich oder gewünscht. Zudem bleiben sensible Betriebsdaten vor Ort.

Gemeinsame Eigenschaften

Aus diesen Beispielen lassen sich drei zentrale Merkmale ableiten:

- Lokalität: Verarbeitung direkt auf dem Gerät, Daten bleiben vor Ort

- Echtzeitfähigkeit: Entscheidungen in Millisekunden

- Ressourcenbeschränkung: Begrenzte Rechenleistung, Speicher und Energie

Zentrale Technischen der eingebetteten KI

Damit KI auf kleinen Geräten funktioniert, müssen Modelle effizienter gestaltet werden als in klassischen Serverumgebungen. Die hierfür verwendeten Techniken lassen sich grob in drei Bereiche aufteilen.

Modellkompression

Große Modelle werden gezielt verkleinert:

- Quantisierung reduziert die Genauigkeit von Zahlen und spart Speicher sowie Rechenleistung

- Pruning entfernt unwichtige Teile des Modells, ohne die Leistung zu stark zu beeinträchtigen

Effiziente Modellarchitekturen

Es existieren speziell entwickelte KI-Modelle, die mit deutlich weniger Ressourcen auskommen. Diese Modelle sind von Grund auf für energie- oder speichereffiziente Berechnung ausgelegt.

Hardwarebeschleunigung

Moderne Geräte enthalten spezialisierte Chips wie NPUs (Neural Processing Units), die KI-Berechnungen effizient ausführen können. Diese sind deutlich energieeffizienter als allgemeine Prozessoren, aber auch maßgeblich stärker auf Aufgaben rund um die Berechnung von KI-Modellen spezialisiert.

Was sind neuronale Netze?

Viele eingebettete KI-Systeme basieren auf neuralen Netzen. Diese sind sehr flexibel und verglichen mit anderen KI-Modellen leistungsfähig, können für jedes KI Problem individuell angepasst werden, benötigen aber vergleichsweise viel Rechenleistung und Trainingsdaten. Sie dennoch in eingebetteten Systemen als eingebettete KI einzusetzen ist daher eine Herausforderung. Neurale Netze sind lose am menschlichen Gehirn inspiriert und bestehen aus miteinander verbundenen Verarbeitungseinheiten.

Ein neuronales Netz verarbeitet Eingaben schichtweise, wobei jede Schicht eine Menge von komplexen mathematischen Gleichungen definiert. Diese erzeugen dann aus ihren Eingaben jeweils eine Ausgabe, die an die nächste Schicht weitergereicht wird. Das Ergebnis der Berechnungen der letzten Schicht ist dann die Ausgabe des gesamten Netzes.

Beim Training werden die trainierbaren Parameter (manchmal auch Gewichte genannt) des Netzes angepasst. Das sind nichts anderes als die Variablen in den angesprochenen mathematischen Gleichungen des neuralen Netzes. Somit bestimmen sie, wie die Eingaben der Schicht verrechnet werden, um die Ausgabe der Schicht zu erzeugen. Durch wiederholtes Training mit Daten lernt das Modell, ihre Eingabedaten in die gewünschte Ausgabe zu verrechnen.

Neuronale Netze in eingebetteter KI: Zwei Ansätze

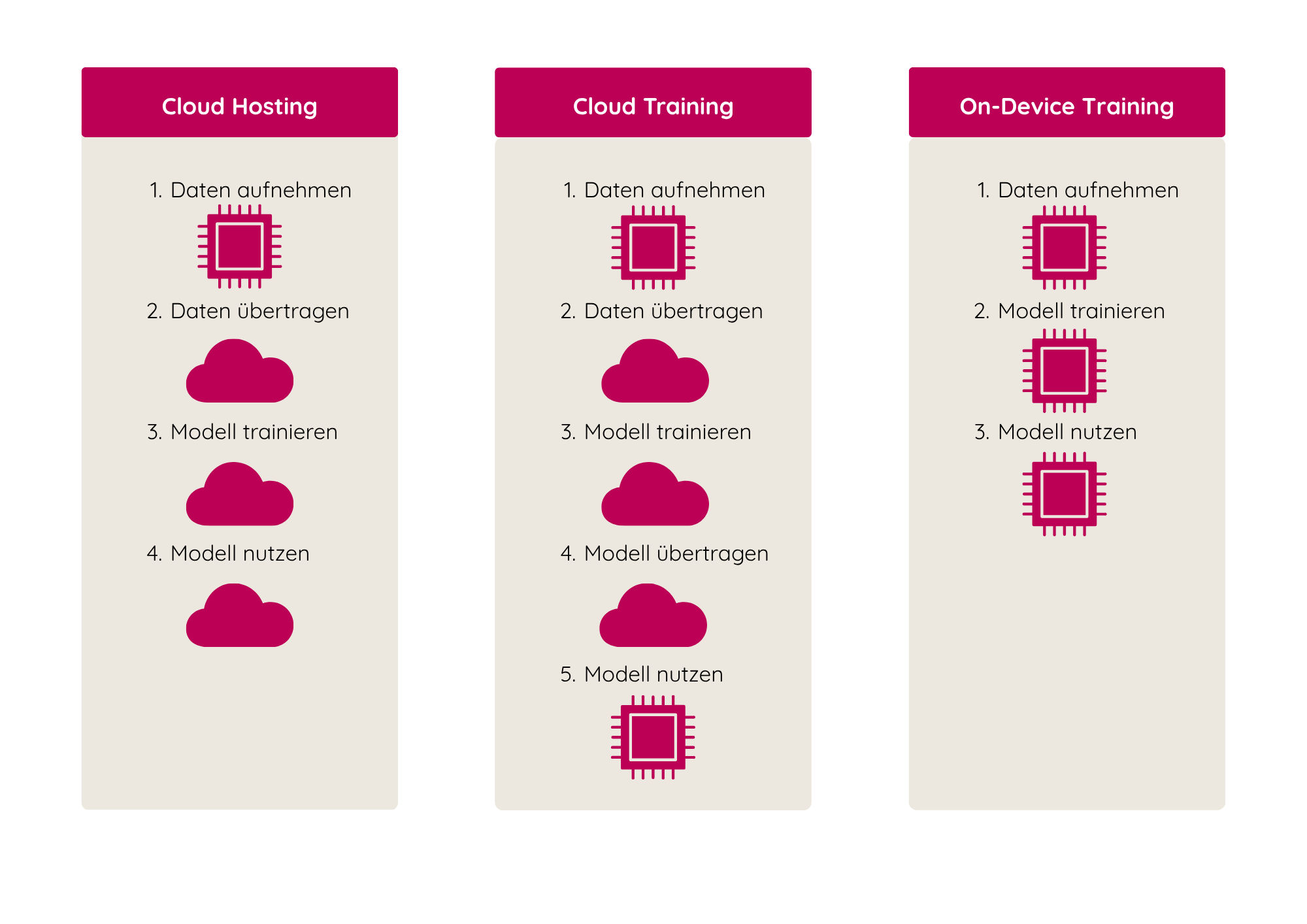

1. Off-Device Training und Deployment

Der klassische Ansatz besteht darin, das Modell zunächst auf leistungsstarker Hardware zu trainieren – etwa in der Cloud oder auf einem Trainingsserver. Anschließend wird das fertige Modell optimiert und auf das Zielgerät übertragen.

Dieser Ansatz hat mehrere Vorteile:

- Zugriff auf große Datenmengen und hohe Rechenleistung

- Stabil kontrollierbare Trainingsprozesse

- Einfachere Entwicklung

Der Nachteil liegt in der eingeschränkten Anpassungsfähigkeit: Nach dem Deployment ist das Modell meist statisch und muss für Änderungen erneut trainiert und verteilt werden.

2. On-Device Training

Beim On-Device Training wird das Modell direkt auf dem Gerät weiter angepasst. Oft erfolgt dies nach einer initialen Trainingsphase außerhalb des Geräts.

Typische Anwendungen sind personalisierte Systeme, etwa bei der Gesichtserkennung auf Smartphones oder bei individuell angepassten Industrieanlagen.

Vorteile dieses Ansatzes:

- Anpassung an Nutzer oder Umgebung

- Keine Übertragung sensibler Daten

Die technischen Herausforderungen sind jedoch erheblich:

- Begrenzte Rechenleistung und Energie

- Komplexere Trainingsprozesse

- Risiko instabiler Ergebnisse

Daher ist On-Device Training aktuell anspruchsvoller, gewinnt jedoch zunehmend an Bedeutung.

Fazit

Die Entwicklung eingebetteter KI wird maßgeblich durch Fortschritte in der Hardware vorangetrieben. Leistungsfähigere und effizientere Chips ermöglichen zunehmend komplexe Modelle direkt auf kleinsten Geräten.

Gleichzeitig entstehen hybride Ansätze, bei denen Geräte lokal arbeiten, aber in bestimmten Fällen mit der Cloud kooperieren, etwa beim sogenannten Federated Learning.

Eingebettete KI wird damit immer stärker Teil unseres Alltags – oft unbemerkt, aber in vielen Situationen entscheidend. Sie verbindet technische Effizienz mit praktischer Relevanz: schnell, lokal und zuverlässig.

Viele Unternehmen stehen dabei vor ähnlichen Fragen: Wo lohnt sich der Einsatz? Welche Daten werden benötigt? Und wie lässt sich ein solches System technisch sinnvoll umsetzen?

Genau hier setzt das ZaKI.D an. Wir unterstützen Unternehmen dabei, Potenziale für eingebettete KI zu identifizieren, Anwendungsfälle zu bewerten und erste prototypische Lösungen zu entwickeln. Unsere Schwerpunkte liegen unter anderem in der industriellen Zustandsüberwachung (z. B. Predictive Maintenance und Fault Prediction) sowie in sensornahen KI-Anwendungen.