In den vergangenen Jahren hat KI enorme Fortschritte gemacht. Insbesondere Large Language Models (LLMs) verfügen über immer umfangreicheres Wissen und sind aus unserem Alltag kaum noch wegzudenken. Doch was wäre, wenn diese Modelle nicht nur „denken“ und kommunizieren, sondern auch aktiv mit ihrer Umwelt interagieren könnten? Genau mit dieser Fragestellung beschäftigt sich das Forschungsfeld der Embodied AI, das künstliche Intelligenz und Robotik eng miteinander verknüpft. Eine zentrale Rolle spielen dabei derzeit die sogenannten Vision-Language-Action-Modelle (VLA-Modelle), die zunehmend an Bedeutung gewinnen.

Alles im Blick: Wie VLA-Modelle das Potenzial von Robotern erweitern

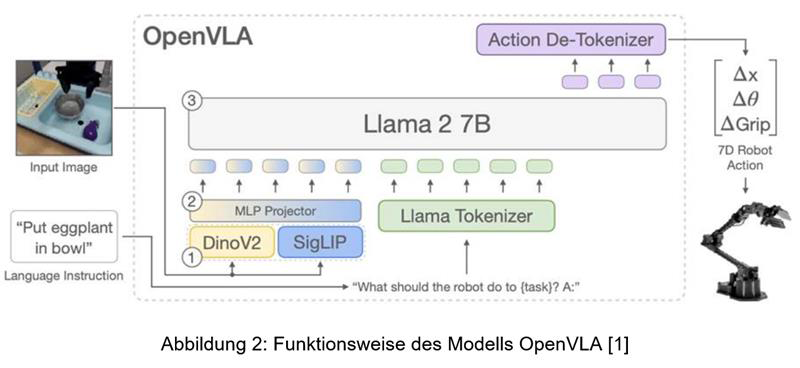

Auch wenn sich Vision-Language-Action-Modelle in ihrer konkreten Architektur unterscheiden, verfolgen sie ein gemeinsames Prinzip: Eine textuelle Anweisung und visuelle Sensordaten werden gemeinsam verarbeitet und direkt in eine Bewegungsaktion überführt. Alles geschieht innerhalb eines einzigen geschlossenen Modells.

Klassische Industrieroboter zeichnen sich vor allem durch drei Eigenschaften aus: hohe Geschwindigkeit, große Präzision und kontinuierlichen Betrieb. Diese Stärken basieren meist auf deterministischen Verfahren wie dem sogenannten Teaching. Dabei werden dem Roboter manuell Referenzpunkte vorgegeben, aus denen er eine Trajektorie berechnet. Je nach Einstellung bewegt er sich entlang gerader Linien oder optimiert den Pfad nach Effizienzkriterien wie Zeit oder Energieverbrauch. Solche Aufgaben lassen sich vollständig mit mathematischen Modellen und fest definierten Regeln lösen.

Erst durch den Einsatz von Computer Vision und Machine Learning gewinnen Roboter deutlich an Flexibilität. Verfahren zur Objekterkennung und die Ableitung von Koordinaten aus Bilddaten ermöglichen es, auch in variablen oder nur teilweise bekannten Umgebungen zu agieren. Für solche Szenarien kommt häufig eine mehrstufige Pipeline zum Einsatz, in der Wahrnehmung, Planung und Ausführung getrennt voneinander ablaufen. Eine typische Pipeline für dynamische Bewegungsplanung sieht daher etwa wie folgt aus:

Das Object Detection Modell wird für bestimmte Objektarten trainiert und kann für genau diese Objekte eine Bounding Box im Kamerabild bestimmen. Die Position in Bezug auf das Koordinatensystem des Roboters muss anschließend algorithmisch ermittelt werden. Daraus errechnet der Roboter mithilfe von inverser Kinematik eine mögliche Bewegung, um diesen Punkt anzufahren. Damit eignet sich dieser Ansatz z. B. sehr gut für Pick-and-Place-Sortieraufgaben.

Die zentrale Einschränkung klassischer Ansätze liegt darin, dass der Roboter lediglich die Position einzelner Objekte kennt, jedoch keinen semantischen Kontext erfasst. Genau hier setzen Vision-Language-Action-Modelle an. Ihr Ziel ist es, Kontextinformationen aus der Umgebung ganzheitlich zu verarbeiten, zu interpretieren und direkt in Roboteraktionen zu übersetzen und das innerhalb eines einzigen, durchgängigen Modells.

Der Input eines VLA-Modells besteht typischerweise aus einer kontinuierlichen Videoaufnahme des Arbeitsraums sowie einem Textprompt, der die gewünschte Aktion beschreibt. Auf dieser Basis generiert das Modell Bewegungs- oder Steuerbefehle für den Roboter.

Seit 2022 wurden nach und nach zahlreiche neue VLA-Modelle präsentiert, deren genaue Architektur variiert. Unter anderem werden Large Language Models, Vision Transformer sowie Image- und Text-Tokenizer in unterschiedlichen Konstellationen miteinander kombiniert und als zusammenhängende Einheit trainiert. Die Funktionsweise lässt sich am Beispiel des Open Source VLA-Modells OpenVLA [1] der Stanford University veranschaulichen.

Architektur

Punkt ① markiert den Vision-Encoder. Für OpenVLA wurden gleich zwei Modelle für diese Aufgabe gewählt, da DinoV2 über ein besonders gutes räumliches Verständnis verfügt, während sich SigLIP durch gute Bild-Sprach-Embeddings auszeichnet. Diese werden über ein einfaches Multi-Layer Perceptron (②) miteinander verschmolzen. Hinzu kommt das Sprachmodell Llama 2 7B (③). Der Llama Tokenizer bettet den Textprompt ein, der die Anweisung für die auszuführende Roboteraktion in natürlicher Sprache enthält. Die Bild- und Text-Embeddings werden zusammen an das LLM übergeben. Diese Verbindung aus Vision- und Language-Modellen wird demnach auch VLM (Vision-Language Model) genannt.

Übersetzung in Aktionen

Wie wird nun aus dem Output eines LLMs eine Roboteraktion? Die Entwickler haben sich dafür eine elegante Lösung einfallen lassen. Schauen wir uns dazu zunächst den sog. Action Space des Roboters an. Um den Roboter zu kontrollieren reichen sieben Dimensionen aus. Dies sind die relativen Translationen und Rotationen des Endeffektors, sowie eine Greifer-Aktion für das Öffnen bzw. Schließen.

a = [Δposx, Δposy, Δposz, Δrotx, Δroty, Δrotz, Δgripper]

Die Greifer-Aktion ist binär: 0 = schließen, 1 = öffnen. Die anderen Dimensionen werden zwischen -1 und 1 skaliert.

Ein LLM generiert als Output jedoch Tokens und keine Gleitkommazahlen. Sollen die Roboteraktionen direkt vom LLM ausgegeben werden, müssen sie ebenfalls durch Tokens repräsentiert werden. Dies ist möglich, indem das Intervall [-1, 1] in viele Einheiten unterteilt wird. Hier wurden 255 Unterteilungen gewählt, sodass eine Roboteraktion folgendermaßen als Token-String dargestellt werden kann:

Aktion (Raw)

[0.00, 0.03, -0.82, 0.00, -0.14, 0.57, 1.00]

Aktion (Tokendarstellung)

„128 132 14 128 110 201 255“

Der gesamte Action Space wird mithilfe von nur 255 Tokens repräsentiert. Diese Sondertokens werden dann in das Vokabular des LLMs integriert, indem die 255 am seltensten verwendeten Tokens des Vokabulars mit ihnen überschrieben werden.

Aktuelle Forschung

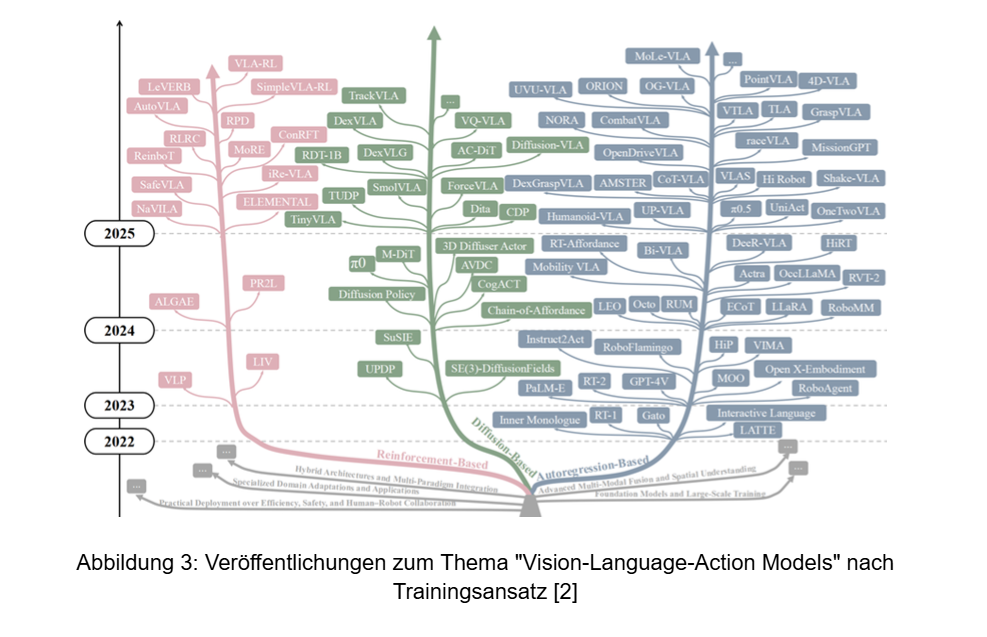

Diese Methode zur Erzeugung von Aktionen ist natürlich nicht die einzige. Inzwischen existieren über 100 verschiedene VLA-Modelle, die verschiedene Trainingsansätze verfolgen. Abbildung 3 zeigt, wie sich das Forschungsfeld innerhalb der letzten 4 Jahre entwickelt hat und welche Arbeiten veröffentlicht wurden.

Woher kommen die Daten für generalisierte VLA-Modelle?

Roboter sind teuer, und die Datengenerierung für Trainingszwecke extrem aufwändig. Ohne öffentliche, kollaborative Datensätze hätten nur die großen Tech-Unternehmen die Ressourcen, leistungsfähige VLA-Modelle zu entwickeln.

Hier setzt das Projekt Open-X-Embodiment [3] an: Ein Zusammenschluss von 34 Forschungseinrichtungen hat eine Sammlung von zunächst 60 Datensätzen [4] aufgebaut, die kontinuierlich erweitert wird. Heute umfasst die Sammlung über 2,4 Millionen Episoden, aufgenommen mit unterschiedlichen Robotermodellen, in diversen Umgebungen und bei verschiedensten Aufgaben. Die Vielfalt dieser Daten ist entscheidend, damit VLA-Modelle auch sogenannte Out-of-Distribution-Tasks (OOD) – also Aufgaben, die sie zuvor noch nicht gesehen haben – zuverlässig ausführen können. Aufgrund ihrer Relevanz bilden diese Datensätze mittlerweile die Grundlage fast aller aktuellen VLA-Modelle.