Wie lassen sich KI-Modelle gemeinsam trainieren, ohne sensible Daten an einem zentralen Ort zu speichern? In diesem Artikel wird erklärt, wie Decentralized Federated Learning (DFL) das Training auf verschiedene Geräte verteilt, die Effizienz steigert und Datenschutz gewährleistet, ohne auf einen zentralen Server angewiesen zu sein.

In den vergangenen Jahren haben wir einen rasanten Wandel bei der Einführung und Integration KI-basierter Methoden in alltägliche Systeme erlebt – von Smartphones über Industriemaschinen bis hin zum Gesundheitswesen und zur Robotik. Dabei liegt der Fokus oft auf der Modellleistung, wie beispielsweise Netzwerkarchitekturen, höherer Genauigkeit, schnellerer Inferenz usw. Doch eine ganz einfache Frage stellen wir uns selten: Wie werden diese Modelle eigentlich trainiert, und wohin fließen all diese Daten?

In den meisten Fällen erfolgt das Training auf einem einzigen zentralen System, das enorme Datenmengen verarbeiten muss, was sowohl rechnerische Herausforderungen als auch inhärente Datenschutzbedenken mit sich bringt. Was wäre aber, wenn diese Rechenlast, einschließlich Modelltraining und Daten, auf mehrere Rechengeräte verteilt werden könnte, anstatt sich auf ein einziges leistungsstarkes Gerät oder einen zentralen Server zu verlassen?

Hier kommt Federated Learning (FL) ins Spiel. Es ermöglicht die Verteilung des Trainings auf mehrere Geräte, von denen jedes über eigene lokale Daten verfügt, und ermöglicht so kollaboratives Lernen, während die Rohdaten auf den Geräten verbleiben und somit der Datenschutz gewahrt bleibt. Und wenn wir diesen Ansatz noch einen Schritt weiterentwickeln und den Lernprozess selbst dezentralisieren, können wir die Abhängigkeit von einem einzelnen Server verringern und Lernsysteme aufbauen, die sicherer, robuster und skalierbarer sind.

Vom zentralisierten zum dezentralisierten Federated Learning

Bevor wir auf Dezentralisierung und Datenschutz eingehen, ist es wichtig zu verstehen, wie sich diese Trainingsparadigmen unterscheiden.

Beginnen wir mit dem einfachsten Fall des zentralisierten Trainings.

Stelle dir vor, du trainierst ein maschinelles Lernmodell auf deinem lokalen Computer oder einem einzelnen Server, der alle Daten speichert und alle Berechnungen durchführt. Diese Konfiguration bietet zwar einen unkomplizierten Ansatz für das Modelltraining, bringt jedoch auch große Herausforderungen mit sich, wie z. B. die gesamte Rechenlast auf einem System, erhöhte Kommunikationskosten, da mehr Daten übertragen werden müssen, und eine Beeinträchtigung des Datenschutzes bei sensiblen Daten, die zentral gespeichert werden [1].

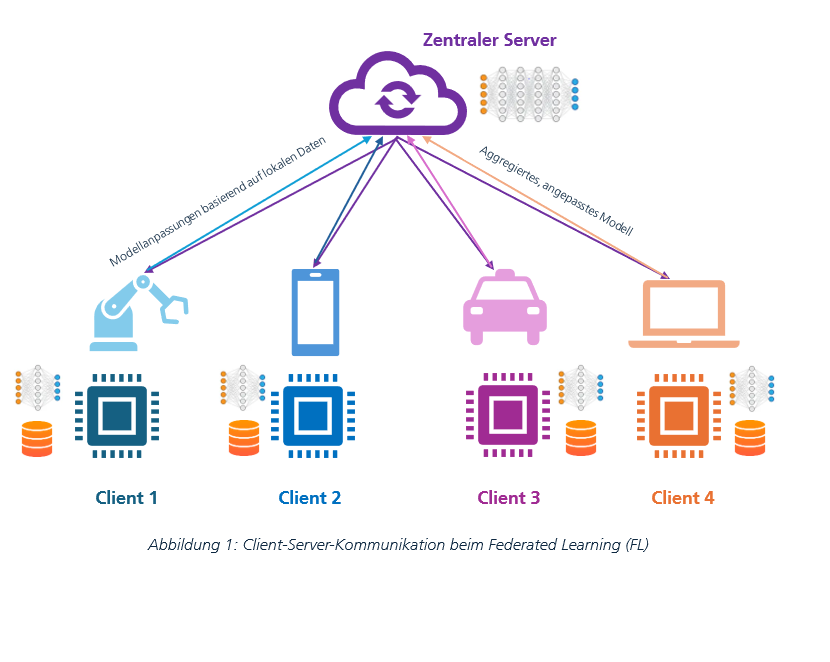

Aus dieser Perspektive des Datenschutzes und der Trainingseffizienz ist Federated Learning (FL) dem zentralisierten Training in verschiedener Hinsicht überlegen. Wie in Abbildung 1 dargestellt, folgt FL einer Server-Client-Architektur, bei der mehrere Clients (wie Telefone, Sensoren oder Roboter) ihr eigenes lokales Modell trainieren und nur ihre Modellaktualisierungen mit dem zentralen Server teilen [2].

Der Server fasst die Aktualisierungen/Informationen aller Beteiligten in einem globalen Modell zusammen und verteilt dieses Modell anschließend wieder an die Clients. Die globale Aggregation auf dem Server erfolgt in der Regel über Aggregationsalgorithmen, die die lokalen Aktualisierungen im Wesentlichen durch verschiedene Strategien kombinieren, wie z. B. FedAvg [2], das einen einfachen Durchschnitt über die Modellaktualisierungen aller teilnehmenden Clients bildet, FedProx [3], das darauf abzielt, das Training unter Datenheterogenität durch einen Regularisierungsterm zu stabilisieren, während Methoden wie SCAFFOLD [4] darauf abzielen, die Drift in den Client-Aktualisierungen durch Kontrollvariaten zu korrigieren. Dieser Aufbau ermöglicht:

- kollaboratives Lernen, da jedes Gerät sein lokales Wissen einbringt und gleichzeitig vom gemeinsamen Lernen des gesamten Netzwerks profitiert [5] und

- verbesserten Datenschutz, da die lokalen Daten auf der Client-Seite verbleiben und nur die Modellgewichte mit dem zentralen Server geteilt werden [6]

Obwohl FL die Zusammenarbeit und den Datenschutz verbessert, spielt der zentrale Server nach wie vor eine wichtige Rolle beim Hosten und Koordinieren des Trainings über alle Clients hinweg, bei der Verwaltung der Kommunikation sowie bei der Modellaggregation. Dies bedeutet, dass das gesamte System vom zentralen Knoten abhängig ist. Dies könnte potenziell zu einem Single Point of Failure werden; falls der Server beispielsweise offline geht, wird der gesamte Trainingsprozess unterbrochen [1].

Zudem können Straggler-Probleme bei FL zu Kommunikationsverzögerungen auf dem Server führen; außerdem kann der Server mit steigender Anzahl teilnehmender Geräte Schwierigkeiten mit dem erhöhten Rechenaufwand und den Speicheranforderungen haben [7]. Darüber hinaus benötigt der zentrale Server eine hohe Kommunikationsbandbreite für die Modellaggregation, und die erneute Verteilung kann das System zusätzlich belasten.

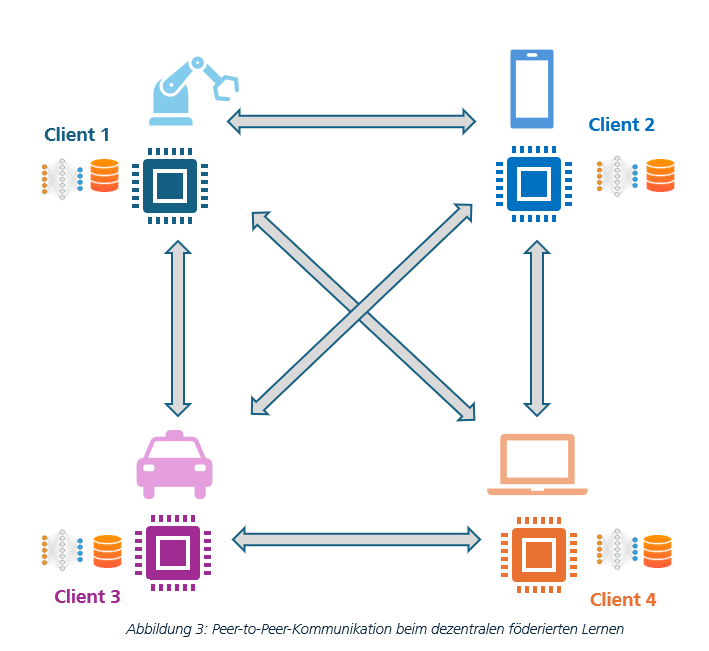

An dieser Stelle tritt das Konzept des Decentralized Federated Learning (DFL) auf den Plan. DFL zielt auf die Einschränkungen des traditionellen FL ab, indem es den zentralen Server vollständig eliminiert und eine direkte Kommunikation zwischen den teilnehmenden Clients ermöglicht [7].

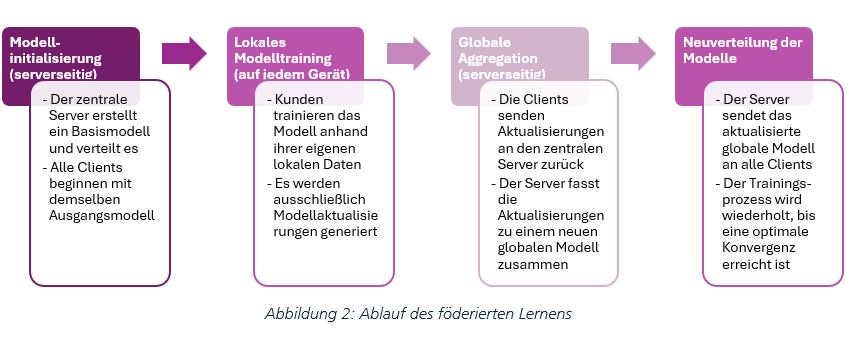

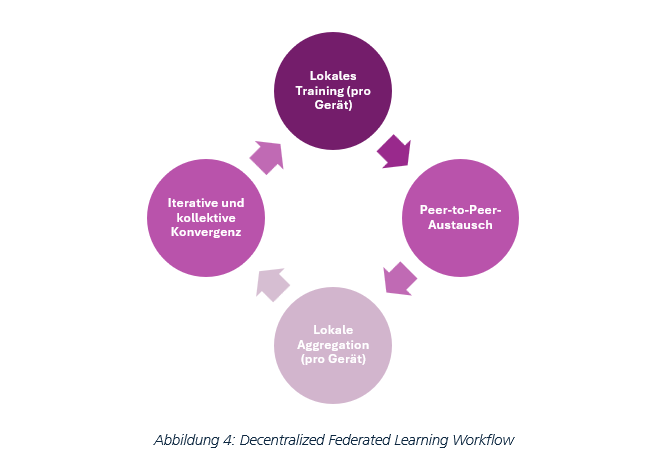

Wie in Abbildung 2 dargestellt, trainiert jedes Gerät das lokale Modell eigenständig und teilt seine Aktualisierungen über Peer-to-Peer-Kommunikation (P2P) mit den teilnehmenden Clients. In dezentralen Konfigurationen kann dieser Austausch zwischen den Peers auch asynchron erfolgen, wobei ein Client sein Modell an seine Peers sendet, sobald er eine lokale Trainingsrunde abgeschlossen hat, anstatt auf eine globale Aggregation zu warten. Je nach Kommunikationsdesign können Clients über vordefinierte Strukturen wie Ringtopologien, vollständig verbundene Netzwerke, graphbasierte Kommunikationsmuster oder Gossip-Learning kommunizieren [8]. Durch wiederholte lokale Mittelwertbildung führen diese verteilten Interaktionen alle Clients zu einem gemeinsamen Modell, ohne auf einen zentralen Koordinator angewiesen zu sein [6].

Dieser Übergang von einem zentralisierten Server, der mehrere Clients koordiniert, hin zu einer vollständigen Dezentralisierung unterstreicht die Bedeutung skalierbarer, robuster und datenschutzkonformer Lernsysteme [1], [7].

Die Bedeutung von Verteilung und datenschutzkonformen Ansätzen

Hast du dir schon einmal Gedanken darüber gemacht, wie es kommt, dass deine Tastatur scheinbar weiß, was du als Nächstes tippen wirst?

Die meisten von uns denken nicht darüber nach, aber jedes Mal, wenn wir Googles Gboard auf unseren Smartphones nutzen, tragen wir unbewusst dazu bei, ein Vorhersagemodell zu trainieren, ohne unsere eigentlichen Daten weiterzugeben [9]. Stattdessen lernt unser Smartphone lokal aus der Eingabe und übermittelt lediglich ein kleines, verschlüsseltes Modell-Update. Das ist FL in unserem Alltag.

Da KI-basierte Systeme mittlerweile in verschiedenen Anwendungsbereichen wie Edge-Computing, Cybersicherheit, Smartphones, Robotik usw. eingesetzt werden, sammeln sie kontinuierlich große Datenmengen, um daraus zu trainieren [5]. Beim traditionellen zentralisierten Training müssen diese Daten an einen Hauptserver gesendet werden, was die Datensicherheit durch die potenzielle Aggregation sensibler Informationen gefährdet und das System anfälliger für Datenlecks macht.

Diese Einschränkungen zentralisierter Trainingsparadigmen werfen eine zentrale Frage auf: Wie können wir gemeinsam trainieren, ohne einen zentralen Server zu überlasten oder den Datenschutz zu gefährden?

Auch hier kommt DFL als Trainingsparadigma zum Tragen, das diese Einschränkungen überwindet, indem es kollaboratives Lernen ohne Weitergabe von Rohdaten ermöglicht und robuste Kommunikationsstrategien zwischen den Clients unterstützt – selbst in dynamischen Umgebungen.

Anwendungen und Grenzen von DFL

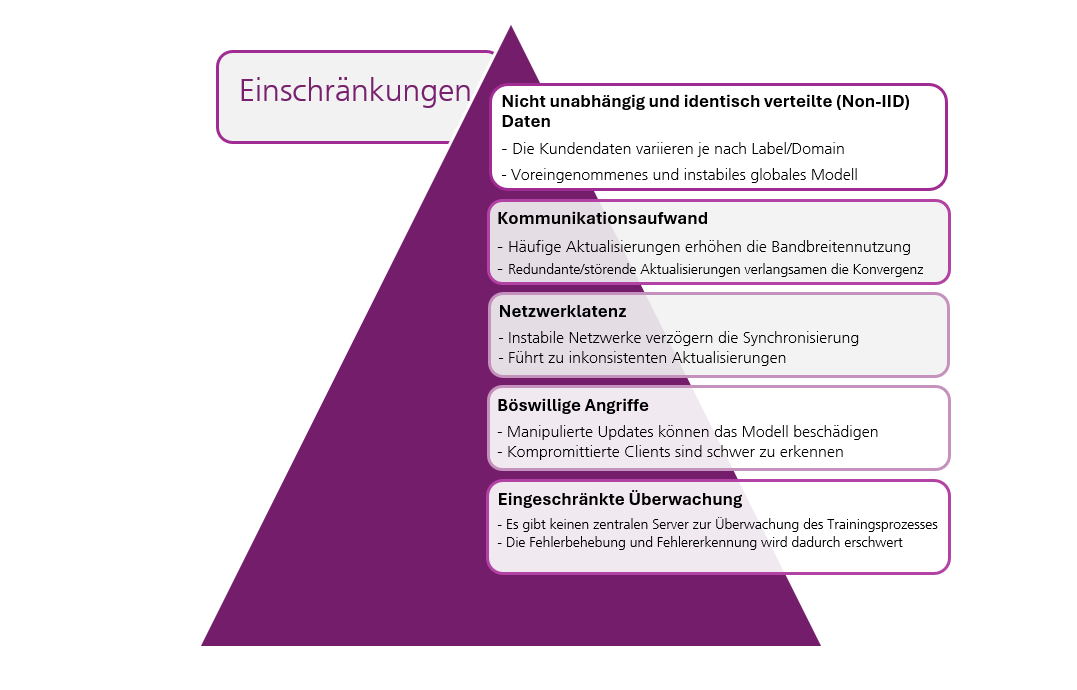

Natürlich hat DFL auch Grenzen, wie in der untenstehenden Abbildung zu sehen:

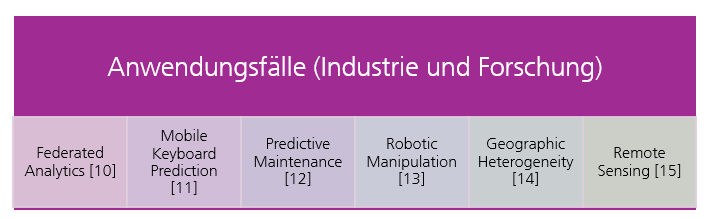

Aus den vorangegangenen Abschnitten wissen wir nun, dass DFL in einer Vielzahl von Bereichen zum Einsatz kommt. Um zu veranschaulichen, wie diese Methoden in der Praxis umgesetzt werden, werden in den folgenden Studien Anwendungen des dezentralen und föderativen Lernens in verschiedenen Bereichen vorgestellt:

Quellen

[1] E. T. M. Beltrán et al., “Decentralized Federated Learning: Fundamentals, State of the Art, Frameworks, Trends, and Challenges,” 2022, doi: 10.48550/ARXIV.2211.08413.

[2] H. B. McMahan, E. Moore, D. Ramage, S. Hampson, and B. A. y Arcas, “Communication-Efficient Learning of Deep Networks from Decentralized Data,” 2016, doi: 10.48550/ARXIV.1602.05629.

[3] T. Li, A. K. Sahu, M. Zaheer, M. Sanjabi, A. Talwalkar, and V. Smith, “Federated Optimization in Heterogeneous Networks”.

[4] S. P. Karimireddy, S. Kale, M. Mohri, S. J. Reddi, S. U. Stich, and A. T. Suresh, “SCAFFOLD: Stochastic Controlled Averaging for Federated Learning,” 2019, arXiv. doi: 10.48550/ARXIV.1910.06378.

[5] S. Abdulrahman, H. Tout, H. Ould-Slimane, A. Mourad, C. Talhi, and M. Guizani, “A Survey on Federated Learning: The Journey From Centralized to Distributed On-Site Learning and Beyond,” IEEE Internet Things J., vol. 8, no. 7, pp. 5476–5497, Apr. 2021, doi: 10.1109/JIOT.2020.3030072.

[6] Q. Li, W. Yu, Y. Xia, and J. Pang, “From Centralized to Decentralized Federated Learning: Theoretical Insights, Privacy Preservation, and Robustness Challenges,” Mar. 10, 2025, arXiv: arXiv:2503.07505. doi: 10.48550/arXiv.2503.07505.

[7] L. Yuan, Z. Wang, L. Sun, P. S. Yu, and C. G. Brinton, “Decentralized Federated Learning: A Survey and Perspective,” 2023, arXiv. doi: 10.48550/ARXIV.2306.01603.

[8] N. A. Tuan, S. Jim Soe Moe, Q. W. Khan, A. Rizwan, and D. H. Kim, “Topology Optimization Techniques for Decentralized Federated Learning: Challenges and Solutions,” in 2025 International Conference on Metaverse Computing, Networking and Applications (MetaCom), Seoul, Korea, Republic of: IEEE, Aug. 2025, pp. 51–56. doi: 10.1109/MetaCom65502.2025.00015.

[9] T. Yang et al., “Applied Federated Learning: Improving Google Keyboard Query Suggestions,” Dec. 07, 2018, arXiv: arXiv:1812.02903. doi: 10.48550/arXiv.1812.02903.

[10] A. R. Elkordy et al., “Federated Analytics: A survey,” Feb. 02, 2023, arXiv: arXiv:2302.01326. doi: 10.48550/arXiv.2302.01326.

[11] A. Hard et al., “Federated Learning for Mobile Keyboard Prediction,” Feb. 28, 2019, arXiv: arXiv:1811.03604. doi: 10.48550/arXiv.1811.03604.

[12] V. Pruckovskaja et al., “Federated Learning for Predictive Maintenance and Quality Inspection in Industrial Applications,” Apr. 21, 2023, arXiv: arXiv:2304.11101. doi: 10.48550/arXiv.2304.11101.

[13] X. Zhou et al., “Decentralized P2P Federated Learning for Privacy-Preserving and Resilient Mobile Robotic Systems,” IEEE Wirel. Commun., vol. 30, no. 2, pp. 82–89, Apr. 2023, doi: 10.1109/MWC.004.2200381.

[14] J. Tan et al., “Bridging Data Islands: Geographic Heterogeneity-Aware Federated Learning for Collaborative Remote Sensing Semantic Segmentation,” Dec. 24, 2024, arXiv: arXiv:2404.09292. doi: 10.48550/arXiv.2404.09292.

[15] H. Lin, C. Zhang, D. Hong, K. Dong, and C. Wen, “FedRSClip: Federated Learning for Remote Sensing Scene Classification Using Vision-Language Models,” Jan. 05, 2025, arXiv: arXiv:2501.02461. doi: 10.48550/arXiv.2501.02461.